宇宙存在自己的尺度,万物也有深度。在空间中,深度代表着什么?深度信息和三维重建是什么关系,有哪些获取深度信息的方式?如视又是如何通过不断创新打造专业级设备,来1:1构建庞大的数字空间?

认识空间深度信息

空间中的“深度”是什么

提到“深度”,很多人想到的是纵向深浅程度,比如水深。在空间中,“深度”(depth)则是指物体与观察点之间的距离,有了距离信息,我们就能够确定物体在三维空间中的确切位置。

空间深度信息广泛应用于3D建模、自动驾驶、增强现实(AR)、虚拟现实(VR)等场景。以自动驾驶为例,车辆可以通过传感器获取的深度信息来识别和避让障碍物,提高行车安全。

而在三维重建中,空间深度信息可以说是构建三维模型的基础。

空间深度信息与三维重建

作为三维重建基础的空间深度信息

在上期《如视新知 | 什么是三维重建?》中,我们介绍了如视当下正在做的三维重建,是采集真实的空间深度信息,结合RGB相机采集的图像信息,经由算法融合后构建1:1真实还原的三维模型的结果。

三维重建技术的基础就是获取目标深度信息,后续经由点云处理、网格处理、纹理映射等步骤,即可生成三维模型。

为什么要采集真实的空间深度信息

深度信息的精度直接影响三维重建质量。

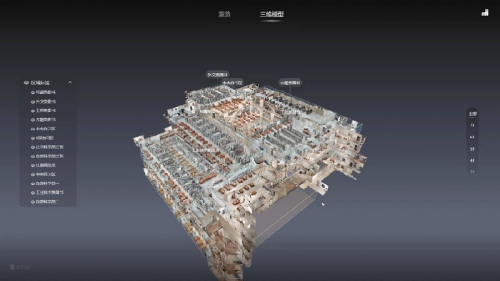

以下图为例,这是一间大型图书馆的三维模型,在进行三维重建时,我们需要知道每层楼、每个区域、书架的准确位置。如果测量的深度信息有误差,生成的整体模型就会不精准。

深度信息越精准,模型越真实

那么,我们该如何获取空间深度信息,又如何提升所获取的深度信息准确性呢?

如何获取空间深度信息?

哪种方案比较好?

常见的获取深度信息方式主要有两大类,一类是被动式测量,即利用自然光反射,使用相机获取图像,通过特定算法计算物体的立体空间信息,如双目视觉法。

另一类则是主动发射激光(如激光雷达)、声波等光源或能量至目标物体,通过计算接收返回光波的时间来获取深度信息的方式,如结构光法、飞行时间法。

这几种方法都可以获取空间深度信息进行三维重建,但在测量精度、使用场景等层面各有区别。

双目视觉法(Stereo Vision)

人眼之所以能够感知深度,是因为物体在我们左右眼中成像不同,大脑通过双目成像差异可以感知距离。

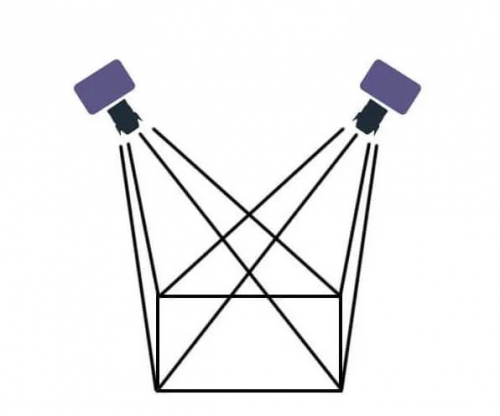

同理,双目视觉法使用相对位置固定的两个摄像头来拍摄同一个物体,通过物体在两个摄像头上成像位置的像素差,根据三角测量法(一种通过测量角度和基线距离来计算物体位置或距离的技术)计算获得物体距离摄像头的深度信息。

双目视觉法示意图

该方法的测量精度同两个摄像头之间的距离,以及摄像头分辨率息息相关。距离物体越远,误差越大,2米之外误差可达5%~10%左右。因此,双目视觉法一般应用在2米以内的深度测量,如近距离小物体建模。

在使用场景中,双目视觉法存在一定限制。对于缺乏明显特征的物体,比如光滑的墙面,由于两个摄像头之间不能捕捉成像差异,因此该方法无法正常工作。

结构光法(Structured light)

作为主动式测量深度的一种方式,结构光法的原理是利用光学投射器,将一定模式的不可见红外结构光斑投射在物体表面,从而在表面形成由被测物体表面形状所调制的光条三维图像。同时,处于另一位置的摄像机探测到该三维图像,获得光条二维畸变图像。

结构光法示意图,不断向物体表面投射光

光条的畸变程度取决于光学投射器与摄像机之间的相对位置和物体表面形状轮廓。当光学投射器与摄像机之间的相对位置一定时,通过计算畸变的二维光条图像坐标,便可以重现物体表面三维形状轮廓。

严格讲,这也是一种双目视觉法,只不过由“被动式”变为“主动发射结构光”。因此,在测量精度上,其存在距离物体越远误差越大的特性。

采用红外结构光方式测量时,推荐测量5米以内的物体深度。所以在使用场景上,结构光法不便采集较大空间,如商场,工厂等。此外,由于在强光环境下无法探测到红外光,所以该方法也不适用于室外等较复杂场景。

飞行时间法(ToF)

飞行时间法又叫ToF(Time of Flight),其原理是通过给目标连续发送光脉冲(激光等),然后用传感器接收从物体返射回来的光,通过记录发射和接收光脉冲的飞行(往返)时间,根据光速计算得到目标物体的距离。

飞行时间法示意图

飞行时间法同上述两种方法相比,其优势之一就是测量精度高。该方法测量的最小精度取决于计时器的精度,因为光飞行1毫米需3.3皮秒,如果计时器要测量1厘米的精度,就需支持区分66皮秒(往返)的计时精度。

正因如此,飞行时间法的测量误差不会因物体距离而变化。与其他方法用百分比来标识误差不同,飞行时间法一般会标定恒定误差,常见范围是厘米级。

基于飞行时间法高精度、低误差的优势,如视采用ToF原理来打造旗下专业激光扫描设备,实现对现实空间的精准采集。

激光雷达+ToF

伽罗华和庞加莱如何体现“专业”

什么是激光雷达?

激光雷达概念

激光雷达(Lidar)并不是一种具体方法,而是一种发射激光的主动式测量深度形式。其根据场景不同,会采用三角测量法或ToF法。采用三角测量法的激光雷达主要应用于近距离场景,如扫地机器人;采用ToF法的激光雷达则应用于中远距离,如空间三维重建,自动驾驶等等,使用场景更加广泛。

激光雷达线数

激光雷达有几组激光收发模块,垂直方向上就有几条线,线的数量称为线数。激光雷达线数越多,能捕捉到的物体细节越丰富,但线数越多雷达体积越大,成本更高。因此,如何选取线数,要综合应用场景、精度要求和成本等因素考虑。

伽罗华的专业性:高精度+高效率

何为“伽罗华”

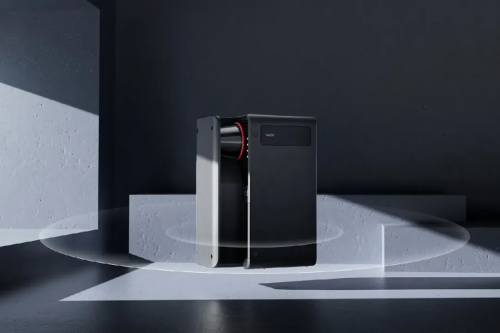

伽罗华(Galois)是如视于2020年4月自主研发并推出的专业级激光VR扫描仪,是全球行业内首个发布大规模应用的定点式激光扫描仪。伽罗华的基本原理是“ToF”,即飞行时间法。其内置一个单线激光雷达,深度模组量程最高可达50米,每秒可采集18600点。同时,伽罗华搭载一个4/3 英寸的大靶面 CMOS彩色鱼眼镜头,可采集2000万像素的单张彩色图像,自动生成1.34亿像素的彩色全景图。

伽罗华

伽罗华的优势

伽罗华采用高精度激光雷达和超高清、高感光彩色镜头,在适用场景和产物质量方面具有显著优势。

室内室外全场景采集:

在采集范围上,伽罗华采集量程可达50米。同时,由于其采用的激光雷达波长940纳米,且高功率输出;而日光波长在380纳米至780纳米之间,因此伽罗华无惧光线干扰,在室内室外、强弱光全场景中皆可集中采集,满足多样化场景采集需求。

产物质量高:

激光雷达的特性,令伽罗华测量精度不受距离影响,进一步提升产物精度。经如视实测,一套100平方米的房间测量误差可控制在0.4%以内。

在色彩方面,伽罗华支持单鱼眼镜头成像,可产出1.34亿像素无拼缝的彩色全景图,相当于16K分辨率,画质效果比肩单反。

衍生场景丰富:

伽罗华还可采集反射率信息、高动态图片信息,为后面推出的MR等创新应用能力打下基础。

庞加莱的专业性:让超大空间三维重建更简单

何为庞加莱

庞加莱(Poincare)是如视于2023年6月推出的一款自主研发的手持实景激光扫描仪,同样采取ToF法。其内置16线激光雷达,探测范围可达120米,每秒可获得320000点,利用SLAM技术扫描空间场景实现三维重建。

庞加莱

作为超大空间三维重建解决方案,不同于此前定点扫描方式,操作人员可以使用庞加莱对空间进行连续式扫描采集。

庞加莱的优势

直出高精度彩色点云:

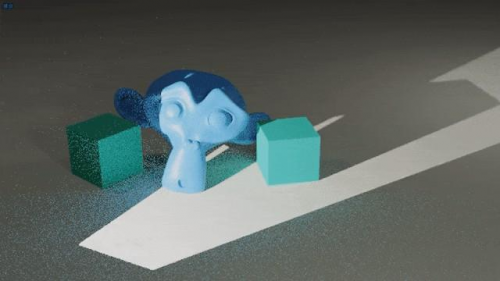

庞加莱能够即时解算高精度着色点云,实现高清点云实时复刻,做到复杂项目也可呈现彩色点云,产物全面覆盖空间结构、纹理、信号强度分布等,1:1真实还原采集场景。

庞加莱直出高精度彩色点云

产物质量支持测绘级:

庞加莱使用先进的算法生成低噪点、高精度数据,测距相对精度误差小于20毫米,生成测绘级产物质量。

采集速度更快:

庞加莱搭载的多线旋转激光雷达,能够全角度覆盖空间进行连续扫描,帮助采集人员节省大量宝贵时间。经实测,1万平方米以上空间扫描速度可快20倍以上。

如果把三维重建过程比作“建房”,那深度信息就是地基,地基稳固,房子才会屹立不倒。作为影响三维重建产物最终效果的重要基础,高效、精准的获取空间深度信息,是如视一直以来的追求。

未来,如视会继续在三维重建领域持续探索,精益求精,不断打磨技术深度,探寻广袤无垠的空间深度,为行业“深度”赋能。

西门子2024 Realize LIVE用户大会:拥抱新质生产力,激发数智新动能

西门子2024 Realize LIVE用户大会:拥抱新质生产力,激发数智新动能 垂类“芒果大模型” 赋能芒果内容生产全链路

垂类“芒果大模型” 赋能芒果内容生产全链路 全国人大代表刘宏志:推动数字乡村建设、激发乡村振兴“数智力量”

全国人大代表刘宏志:推动数字乡村建设、激发乡村振兴“数智力量” “千翼飞舞天际 5G闪耀广州”2023数字科技生态大会 11月10日中国·广州

“千翼飞舞天际 5G闪耀广州”2023数字科技生态大会 11月10日中国·广州 情人节不止214 DR钻戒将七夕情人节传至海外

情人节不止214 DR钻戒将七夕情人节传至海外 华为智选x膳魔师强势合作,致力于联力打造智能水杯标杆

华为智选x膳魔师强势合作,致力于联力打造智能水杯标杆 东方企业创新发展中心与淮安举行战略合作签约仪式

东方企业创新发展中心与淮安举行战略合作签约仪式 亿达科创出席国字盛会 共话数字贸易高质量发展

亿达科创出席国字盛会 共话数字贸易高质量发展